引言:超越文本的AI

人工智能正经历一场深刻的范式转变。以GPT-3为代表的纯文本大语言模型(LLMs)已展现出惊人的能力,但人类的感知和认知本质上是多模态的。我们通过视觉、听觉等多种感官与世界互动。为了构建更通用、更自然的人工智能,研究者们正致力于开发能够同时理解和生成文本、图像、音频乃至视频的模型——即多模态大模型。

以OpenAI的GPT-4V(ision)和Google的Gemini为代表的新一代模型,标志着AI从“单通道”理解向“全感官”交互的跨越。它们不仅能回答关于图片的问题,还能根据草图生成代码、分析视频中的事件,甚至创作融合多种媒介的内容。这不仅仅是功能的叠加,更是对世界进行统一表征和推理能力的质变。

图1: 多模态AI整合视觉、语言、听觉等多种信息流进行综合理解与生成。

核心技术:架构与对齐

多模态大模型的核心在于将不同类型的数据映射到一个共享的语义空间,并让模型学会在此空间内进行跨模态的关联和推理。主流架构主要分为两类:

- 融合编码器架构:如Flamingo、BLIP-2。它们使用独立的预训练编码器(如ViT处理图像,BERT处理文本),然后通过一个轻量级的“融合模块”(如交叉注意力层)将不同模态的特征连接起来,输入到LLM中进行理解和生成。这种方式计算效率较高。

- 端到端统一架构:如GPT-4V、Gemini。它们更倾向于将所有模态的输入(图像像素、音频波形、文本token)都转换或“翻译”成一种统一的表示(通常是类似文本的token序列),然后由一个庞大的、统一训练的Transformer模型进行处理。这种方式能实现更深层次的模态融合。

跨模态对齐:连接视觉与语言

训练的关键是“对齐”,即让模型学会“猫”这个文字token与猫的图片特征在语义空间中是相近的。这通常通过海量的图文对数据集(如LAION)进行对比学习来实现。其目标函数可以简化为最大化配对样本的相似度,同时最小化非配对样本的相似度:

其中,\( I_i \) 和 \( T_i \) 是配对的图像和文本特征向量,\( \text{sim} \) 是相似度函数(如余弦相似度),\( \tau \) 是温度参数。

图2: 多模态模型架构示意图,展示了不同模态信息通过编码器融合的过程。

应用场景:从创意到分析

多模态能力极大地扩展了AI的应用边界,使其从“对话机器人”演变为“全能助手”。

1. 增强型内容创作与设计

- 图文生成:根据详细的文字描述生成高度匹配的图像(如DALL-E 3, Midjourney),或反过来为给定图像撰写标题、故事和营销文案。

- 交互式设计:上传一张房间照片,要求AI“将其改造成现代简约风格”并生成效果图;或绘制一个网站草图,让AI直接生成前端代码。

2. 深度分析与推理

- 学术研究:上传复杂的科学图表(如蛋白质结构、电路图),AI可以解释其原理、总结发现,甚至指出潜在问题。

- 商业智能:分析包含图表和文字的行业报告,自动提取关键数据、趋势,并生成执行摘要。

- 医疗辅助:结合医学影像(X光、病理切片)和患者病历文本,提供初步的鉴别诊断参考。

3. 无障碍交互与教育

- 视觉辅助:为视障人士实时描述周围环境、阅读文档中的文字和图表内容。

- 个性化学习:学生可以拍摄一道数学题,AI不仅给出答案,还能通过图文并茂的方式分步骤讲解。

# 概念性代码:使用多模态API进行图像问答

import openai

# 假设client已配置

response = client.chat.completions.create(

model="gpt-4-vision-preview",

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "这张图片里有什么?描述一下场景。"},

{

"type": "image_url",

"image_url": {"url": "https://example.com/scene.jpg"},

},

],

}

],

max_tokens=300,

)

print(response.choices[0].message.content)核心挑战与局限

尽管前景广阔,多模态大模型的发展仍面临多重挑战。

- 幻觉与事实性错误:模型可能会“看到”图片中不存在的内容,或对视觉信息进行过度解读和捏造。例如,将模糊的物体 confidently 识别为错误的东西。

- 时空推理能力薄弱:理解视频中事件的因果关系、物体的连续运动轨迹,或需要复杂空间推理的任务(如根据2D图纸想象3D结构)仍是难点。

- 数据偏见与安全性:训练数据中的社会文化偏见会被模型吸收并放大。同时,模型可能被用于生成误导性内容(深度伪造)或绕过内容安全限制。

- 惊人的计算成本:训练和运行这些模型需要海量的计算资源(数万张GPU),导致高能耗和高门槛,限制了其可及性和可复现性。

- 评估体系不完善:如何全面、客观地评估一个模型的多模态理解与生成能力,目前仍缺乏公认的、鲁棒的基准测试集。

未来展望与研究方向

为了克服现有局限,社区的研究方向正朝着更高效、更可靠、更通用的目标迈进。

- 高效架构与训练:研究更高效的模型架构(如MoE混合专家模型)、训练方法(如课程学习)和压缩技术,以降低计算和部署成本。

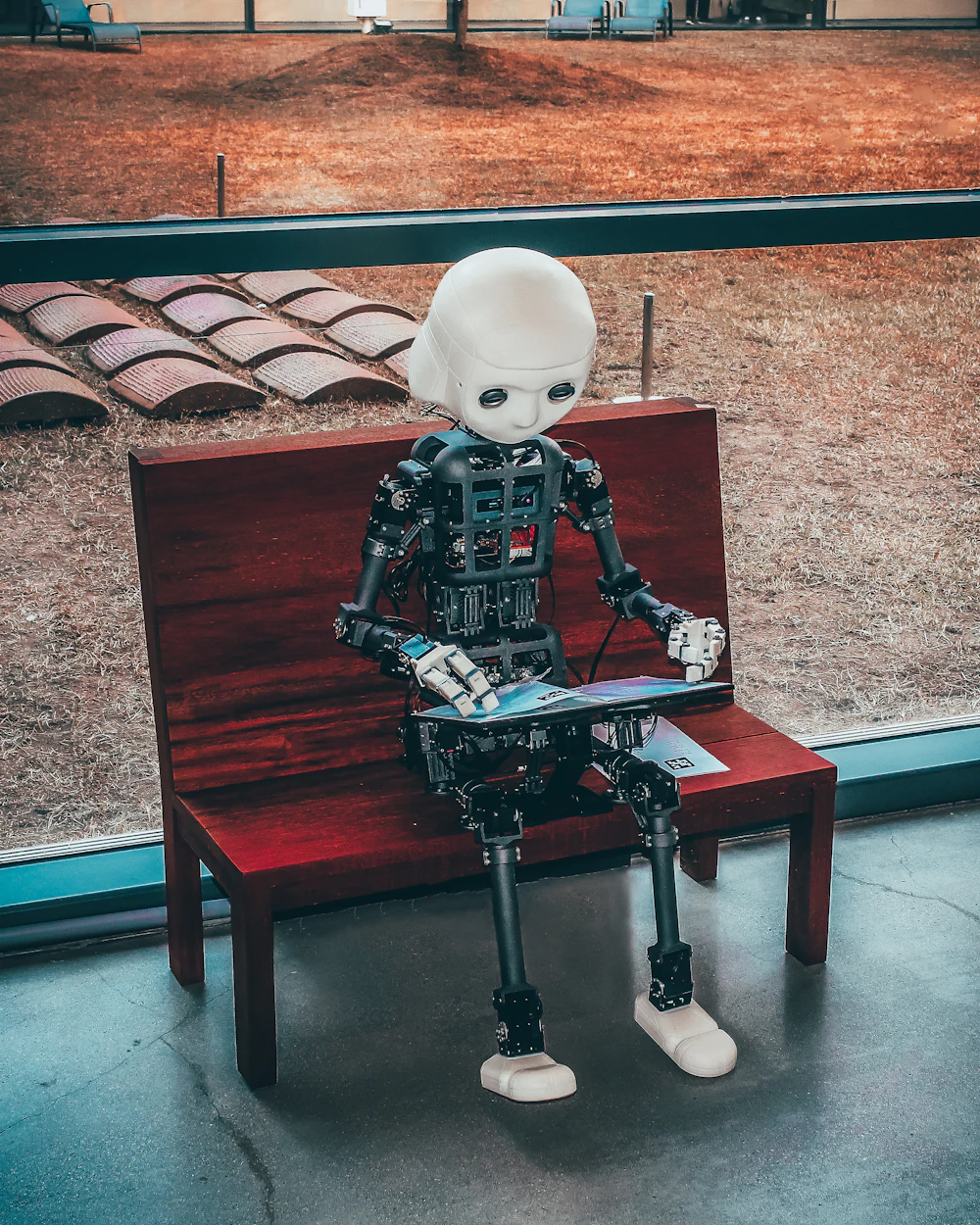

- 具身智能与机器人学:将多模态大模型作为机器人的“大脑”,使其能理解自然语言指令、感知3D环境并规划行动,实现与物理世界的交互。

- 因果推理与可解释性:增强模型对“为什么”的理解,而不仅仅是“是什么”。开发工具来追溯模型的决策过程,提高其透明度和可信度。

- 主动感知与持续学习:让模型学会主动提问以澄清模糊信息,并能在部署后持续从新数据中学习,而无需昂贵的全量重新训练。

- 开源与生态建设:推动高质量多模态数据集的开放,以及中小规模高效模型的开发,构建健康、多元化的技术生态。

图3: 多模态AI是迈向具身智能和通用人工智能(AGI)的关键一步。

结论

多模态大模型代表了AI发展的一个重要里程碑,它通过整合多种感知通道,让人工智能向人类更自然、更全面的认知方式靠拢。从GPT-4V到Gemini,我们看到了模型在理解复杂、异构信息方面的巨大潜力。

然而,这条道路并非坦途。幻觉问题、计算成本、伦理安全等挑战亟待解决。对于开发者和研究者而言,当前既是机遇也是责任。机遇在于可以利用这些强大的基础模型,在创意、教育、医疗、科研等无数领域构建革命性的应用。责任则在于需要以审慎和批判性的态度参与其中,共同探索负责任的AI开发与部署范式。

未来,多模态AI将不仅仅是接受指令的工具,而可能成为能够主动观察、推理并与我们协作的伙伴。深入理解其原理、能力和边界,是每一位身处AI浪潮中的从业者把握未来的关键。