引言:为何需要“可解释”的AI?

想象一下,一个AI系统拒绝了你的贷款申请,或一个医疗AI建议进行一项高风险手术,却无法告诉你“为什么”。这就是“黑盒”AI的典型困境——模型(如深度神经网络)虽然强大,但其内部决策逻辑对人类而言如同一个不透明的盒子。

随着AI在金融、医疗、司法等关键领域的深度渗透,对模型透明度和可信度的要求日益迫切。可解释AI(Explainable AI, XAI)应运而生,旨在构建人类能够理解、信任和有效管理的AI系统。

什么是可解释AI(XAI)?

可解释AI是一系列旨在使AI模型决策过程对人类用户透明、可理解的技术和方法论的总称。其目标不仅仅是让模型“工作”,更是让人们明白它“如何工作”以及“为何做出某个特定决策”。

- 透明性: 模型本身的结构和参数易于理解(如线性回归)。

- 事后解释: 在复杂模型(黑盒)做出决策后,提供对其推理过程的解释。

- 可信任性: 通过解释建立用户对AI系统的信心。

- 公平性与问责制: 识别并纠正模型中的偏见,明确责任归属。

图1: “黑盒”模型与“玻璃盒”(可解释)模型的对比示意图

核心方法:如何解释AI?

XAI的方法主要分为两大类:内在可解释模型和事后解释方法。

内在可解释模型

这类模型本身结构简单,决策逻辑清晰,例如决策树、线性回归、广义加性模型(GAMs)。它们的优势是天然可解释,但通常在复杂任务上的性能不及深度学习模型。

事后解释方法

这是XAI的主流,针对已经训练好的复杂“黑盒”模型(如神经网络、随机森林)提供解释。核心思想是通过分析模型的输入输出关系,来近似或模拟其局部或全局的决策逻辑。下文将重点介绍两种流行的事后解释方法。

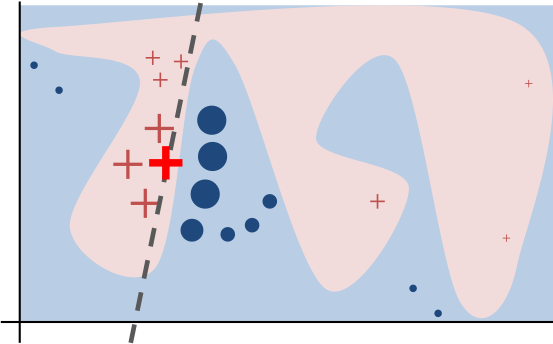

LIME:局部可解释模型

LIME(Local Interpretable Model-agnostic Explanations,局部可解释模型无关解释)的核心思想是:虽然全局解释一个复杂模型很难,但在单个预测点附近,可以用一个简单的可解释模型(如线性模型)来近似黑盒模型的行为。

工作流程:

- 选择一个需要解释的预测实例(如图像中的一个“青蛙”分类)。

- 在该实例周围生成许多微扰样本(如遮盖图像的不同部分)。

- 用黑盒模型为这些微扰样本做预测,得到一组(输入,输出)数据。

- 用一个简单的可解释模型(如带L1正则化的线性回归)去拟合这组数据。

- 这个简单模型的权重就解释了哪些特征对该实例的预测最重要。

图2: LIME方法示意图:用局部线性模型解释复杂模型的单个预测

优缺点

- 优点: 模型无关,灵活;提供直观的局部特征重要性;适用于文本、图像、表格数据。

- 缺点: 解释仅限于局部,可能不稳定;微扰样本的生成方式可能影响结果。

SHAP:基于博弈论的解释

SHAP(SHapley Additive exPlanations)源于合作博弈论中的沙普利值(Shapley Value),为每个特征分配一个值,代表该特征对模型预测的“贡献度”。

其核心公式是沙普利值:

其中:

- \(N\) 是所有特征的集合。

- \(S\) 是不包含特征 \(i\) 的一个特征子集。

- \(f(S)\) 是仅使用特征子集 \(S\) 时模型的预测值。

- \(\phi_i\) 就是特征 \(i\) 的SHAP值,表示特征 \(i\) 对所有可能特征联盟的边际贡献的平均值。

SHAP值具有坚实的理论基础,满足局部准确性、缺失性和一致性等理想属性。一个预测值可以分解为所有特征SHAP值之和加上基线(所有特征缺失时的预期预测值)。

图3: SHAP摘要图,显示每个特征对模型输出的影响(正向/负向)及重要性排序

优缺点

- 优点: 理论基础坚实,提供一致且统一的特征贡献度量;支持全局和局部解释。

- 缺点: 计算成本高(需评估大量特征子集);有各种近似算法(如TreeSHAP, KernelSHAP)来加速。

应用场景与挑战

应用场景

- 医疗诊断: 解释AI为何判断某张影像为恶性肿瘤,帮助医生验证并建立信任。

- 金融风控: 向客户解释贷款被拒的具体原因(如“收入水平”和“负债比”是关键负向因素)。

- 模型调试: 识别模型是否依赖于错误的、有偏见的或不相关的特征(如通过种族进行预测)。

- 合规与监管: 满足如欧盟《人工智能法案》等法规对高风险AI系统透明度的要求。

主要挑战

- 解释的“正确性”: 如何验证一个事后解释是否真实反映了模型的决策机制?

- 性能与解释性的权衡: 最准确的模型往往最不透明。

- 用户理解差异: 不同背景的用户(开发者、领域专家、普通用户)需要不同层次的解释。

- 计算开销: 生成高质量解释(尤其是SHAP)可能需要大量计算。

代码实践:使用SHAP解释模型

以下是一个使用Python的`shap`库来解释一个简单的分类模型的示例。

# 导入必要的库

import shap

import xgboost

import numpy as np

import pandas as pd

from sklearn.model_selection import train_test_split

# 1. 准备数据(以经典的泰坦尼克数据集特征为例)

# 假设我们有一个DataFrame `X` 和标签 `y`

# X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 2. 训练一个黑盒模型(这里用XGBoost)

model = xgboost.XGBClassifier(n_estimators=100, random_state=42)

model.fit(X_train, y_train)

# 3. 创建SHAP解释器

# 使用TreeExplainer,因为它针对树模型进行了高效优化

explainer = shap.TreeExplainer(model)

# 4. 计算测试集样本的SHAP值

shap_values = explainer.shap_values(X_test)

# 5. 可视化解释

# 5.1 单个预测的解释(力力图)

shap.initjs() # 初始化JavaScript可视化(用于Notebook环境)

# 解释第一个测试样本

shap.force_plot(explainer.expected_value, shap_values[0,:], X_test.iloc[0,:])

# 5.2 全局特征重要性摘要图

shap.summary_plot(shap_values, X_test, plot_type="bar")

# 5.3 显示特征影响的方向和程度(蜂群图)

shap.summary_plot(shap_values, X_test)运行上述代码后,你将得到直观的图表,清晰地展示哪些特征对模型的预测影响最大,以及每个特征是如何影响单个预测结果的(是推高还是拉低预测值)。

结论与展望

可解释AI(XAI)是连接强大但晦涩的AI模型与人类理解、信任及监管的关键桥梁。通过LIME、SHAP等工具,我们得以窥见“黑盒”内部的逻辑,确保AI的决策是合理、公平且可问责的。

未来,XAI的发展方向可能包括:

- 更高效的解释算法: 降低计算成本,实现实时解释。

- 标准化与评估框架: 建立衡量解释质量的标准。

- 人机交互界面: 设计更直观、交互性更强的解释呈现方式。

- 因果解释: 不仅解释相关性,更深入探索特征与结果之间的因果关系。

作为AI的研究者或应用者,理解并善用XAI技术,不仅是为了满足外部要求,更是为了构建更稳健、更可靠、最终更能造福社会的智能系统。让AI在照亮世界的同时,自身也变得更加透明。