引言:从LLM到MLLM

大语言模型(LLMs)如GPT系列彻底改变了我们与文本信息交互的方式。然而,现实世界的信息本质上是多模态的——我们通过视觉、听觉和文本综合理解环境。多模态大语言模型(Multimodal Large Language Models, MLLMs)应运而生,旨在打破模态壁垒。

以GPT-4V(ision)、Google的Gemini和开源模型LLaVA为代表,MLLMs能够同时处理和生成文本、图像、音频甚至视频内容。这标志着AI从单一模态理解向更接近人类认知的跨模态推理迈出了关键一步,为更通用的人工智能铺平了道路。

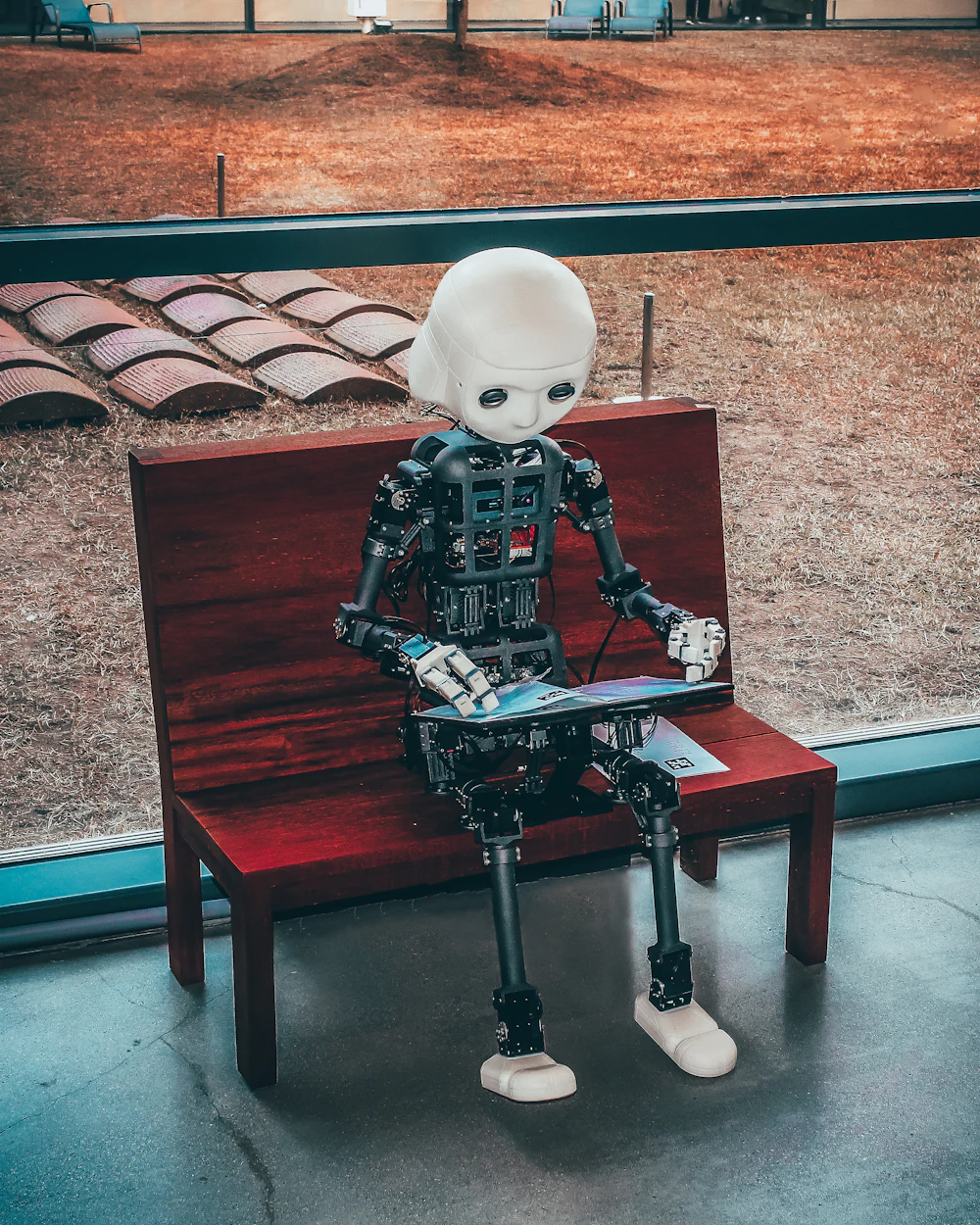

图1: 多模态AI整合视觉、语言、听觉等信息进行综合推理

核心架构解析

典型的MLLM架构通常遵循“编码器-对齐器-LLM”的三段式设计,将不同模态的信息统一到LLM能够理解的语义空间中。

1. 模态特定编码器

- 视觉编码器:通常使用预训练的视觉Transformer(如ViT、CLIP的视觉塔)将图像或视频帧编码为一系列特征向量(视觉tokens)。

- 音频编码器:可能使用Whisper的音频编码器或自定义网络,将音频波形转换为频谱图特征或直接的特征序列。

- 文本编码器:LLM本身的Tokenizer和嵌入层负责处理文本输入。

2. 跨模态对齐与投影

这是MLLM的核心。非文本特征(如图像patch特征)需要通过一个投影网络(通常是简单的多层感知机MLP或交叉注意力模块)被映射到文本特征所在的语义空间。这个过程可以形式化地表示为:

其中,\( \mathbf{H}_v \) 是视觉编码器的输出特征,\( \mathbf{H}_v' \) 是与文本token维度对齐后的特征。

3. 大语言模型骨干

处理后的多模态token序列(文本token + 投影后的视觉/音频token)被拼接在一起,输入到冻结或微调的LLM骨干(如LLaMA、Vicuna)中。LLM基于其强大的序列建模和推理能力,生成最终的文本响应。

图2: 多模态模型典型架构示意图,展示了信息融合流程

关键技术突破

MLLM的快速发展得益于以下几项关键技术的成熟与创新:

- 大规模高质量对齐数据:如LAION-5B、COCO Captions等图文对数据集,以及Instruction Tuning数据(如LLaVA-Instruct),教会模型遵循指令进行多模态对话。

- 高效的训练策略:

- 两阶段训练:先冻结LLM,只训练投影层对齐特征;再以较低学习率端到端微调全部参数。

- 参数高效微调(PEFT):使用LoRA或QLoRA技术,仅微调少量适配器参数,大幅降低计算成本。

- 统一的序列建模:将图像视为“外语”,通过投影层翻译成LLM的“母语”(文本token序列),使LLM能够用处理文本的相同机制处理视觉信息。

- 涌现的跨模态推理能力:当模型规模足够大时,会涌现出令人惊讶的零样本能力,如根据图表进行推理、理解幽默漫画、描述复杂场景等。

应用场景与实例

MLLM正在重塑众多行业的交互方式:

- 智能助手与无障碍技术:为视障人士描述周围环境,识别物体并回答相关问题。

- 教育:解答包含图表、公式的理科问题,提供分步解题思路。

- 内容创作与设计:根据文字描述生成或编辑图像,为已有图像撰写创意文案。

- 医疗辅助:初步分析医学影像(如X光片)的报告,辅助医生进行诊断(需严格验证)。

- 机器人交互:使机器人能通过视觉观察环境,并用自然语言与人类交流任务状态和计划。

实例:用户上传一张冰箱内部的照片,MLLM可以识别其中的食材,并根据用户“用这些食材做一顿晚餐”的指令,生成包含步骤的菜谱。

主要挑战与局限

尽管前景广阔,MLLM仍面临一系列严峻挑战:

- 幻觉问题:模型可能生成与输入图像无关或事实错误的描述,尤其在细节处理上。

- 细粒度理解不足:难以精确计数、阅读微小文字、理解空间关系(如左右、前后)。

- 计算成本高昂:处理高分辨率图像需要编码大量视觉token,极大增加了LLM的序列长度和推理开销。

- 数据偏差与安全:训练数据中的社会文化偏差会反映在模型中,且可能被用于生成有害内容。

- 评估困难:缺乏统一、全面的基准测试来评估模型的真实跨模态理解和推理能力。

- 模态不平衡:当前模型多以“视觉-语言”为主,对音频、视频、3D等其他模态的整合仍处于早期阶段。

未来发展方向

研究社区正从以下几个方向推动MLLM的进化:

- 更高效的架构:探索稀疏注意力、动态token压缩、感知器重采样等技术,降低长序列处理成本。

- 从感知到行动:发展“具身多模态模型”,使AI不仅能看和说,还能在物理世界中规划和执行动作。

- 世界模型集成:让MLLM内建对物理世界常识和因果关系的理解,提升其推理的合理性和可预测性。

- 开源与小型化:类似LLaVA的社区驱动项目,致力于开发更轻量、可复现、可定制的MLLM,降低研究和应用门槛。

- 多模态Agent:将MLLM作为核心“大脑”,驱动能够使用工具(如搜索引擎、代码解释器)、与环境持续交互的智能体。

简易实现思路

以下是一个基于开源库(如Transformers)构建简易视觉-语言模型的伪代码框架,展示了核心流程:

import torch

from transformers import AutoProcessor, AutoModelForCausalLM, CLIPVisionModel

from PIL import Image

class SimpleMLLM(torch.nn.Module):

def __init__(self, llm_name="microsoft/phi-2", vision_name="openai/clip-vit-base-patch32"):

super().__init__()

# 1. 加载预训练组件

self.llm = AutoModelForCausalLM.from_pretrained(llm_name)

self.vision_encoder = CLIPVisionModel.from_pretrained(vision_name)

self.processor = AutoProcessor.from_pretrained(llm_name)

# 2. 冻结LLM和视觉编码器(可选)

for param in self.llm.parameters():

param.requires_grad = False

for param in self.vision_encoder.parameters():

param.requires_grad = False

# 3. 可训练的投影层(将视觉特征映射到LLM词嵌入空间)

vision_feat_dim = self.vision_encoder.config.hidden_size

llm_embed_dim = self.llm.config.hidden_size

self.visual_projection = torch.nn.Linear(vision_feat_dim, llm_embed_dim)

def forward(self, images, input_texts):

# 编码图像

with torch.no_grad():

vision_outputs = self.vision_encoder(images)

# 取[CLS] token或所有patch特征的平均

image_features = vision_outputs.last_hidden_state[:, 0, :] # [batch, feat_dim]

# 投影视觉特征

projected_visual_tokens = self.visual_projection(image_features) # [batch, llm_embed_dim]

# 可以重复或添加特殊token来形成视觉token序列

visual_token_seq = projected_visual_tokens.unsqueeze(1) # [batch, 1, llm_embed_dim]

# 编码文本

text_inputs = self.processor(text=input_texts, return_tensors="pt", padding=True)

text_embeddings = self.llm.get_input_embeddings()(text_inputs['input_ids'])

# 拼接多模态序列:[视觉token] + [文本token]

combined_embeddings = torch.cat([visual_token_seq, text_embeddings], dim=1)

# 通过LLM生成

outputs = self.llm(inputs_embeds=combined_embeddings, attention_mask=...)

return outputs.logits

# 使用示例(概念性)

# model = SimpleMLLM()

# image = Image.open("example.jpg").convert("RGB")

# processed_image = processor(images=image, return_tensors="pt")['pixel_values']

# logits = model(processed_image, ["描述这张图片。"])注意:这是一个高度简化的概念框架。实际训练需要精心设计数据格式(如添加特殊标记`

结论与展望

多模态大语言模型代表了AI向更通用、更人性化交互迈进的重要里程碑。它们通过将LLM强大的语言理解和生成能力与视觉等模态的感知能力相结合,开启了人机交互的新范式。

然而,从“能看会说”到“真知灼见”,MLLM仍有很长的路要走。未来的突破将依赖于:

- 更高效的架构与训练算法,以控制成本。

- 更高质量、更多样化的跨模态数据。

- 对模型幻觉、偏见等根本性问题的深入研究和解决。

- 建立严谨的评估体系,推动技术健康发展。

对于开发者和研究者而言,现在正是深入探索这一领域的黄金时期。无论是参与开源项目、基于现有API构建创新应用,还是投身于底层技术研究,都有机会在塑造多模态AI未来的进程中留下自己的印记。