引言:超越单一模态的AI

人类通过视觉、听觉、语言等多种感官协同来认知世界。传统AI模型往往专注于单一类型的数据,如纯文本大语言模型(LLMs)或计算机视觉模型。多模态大模型(Large Multimodal Models, LMMs)旨在打破这一界限,构建能够同时处理和关联文本、图像、音频甚至视频的通用智能体。

以GPT-4V、Gemini、Claude 3等模型为代表,LMMs标志着AI从“专家”向“通才”演进的关键一步。它们不仅能描述图片内容,还能基于图表进行推理、理解幽默梗图、甚至根据草图生成代码。

图1: 多模态AI旨在像人脑一样整合多种信息流进行理解。

核心技术:对齐与融合

构建LMM的核心挑战在于如何让来自不同“语言”(模态)的信息在同一个语义空间内对话。这主要依赖于两大关键技术:

1. 模态对齐

通过海量的图文对、音视频-文本对数据,训练模型学习不同模态信号之间的对应关系。例如,让模型学会“狗”这个文本token与各种狗的图片像素模式相关联。这通常通过对比学习损失函数实现:

其中,\( v_i \) 和 \( t_i \) 是匹配的图像和文本嵌入,\( \text{sim} \) 是相似度函数(如余弦相似度),\( \tau \) 是温度参数。该损失函数鼓励匹配的图文对具有高相似度,而不匹配的对具有低相似度。

2. 特征融合

将对齐后的多模态特征输入到一个统一的Transformer架构中进行深度融合与推理。融合可以在不同层级发生:

- 早期融合:在输入编码后立即拼接或交叉注意力。

- 中期融合:在多个Transformer层中插入交叉注意力模块。

- 晚期融合:分别处理各模态,最后在决策层融合。

目前主流LMMs多采用中期或早期融合,以实现更细粒度的交互。

主流架构解析

大多数LMMs遵循一个通用的“编码器-桥接器-LLM”范式:

图2: 典型的多模态大模型架构流程。

- 专用编码器:使用预训练的视觉Transformer(如ViT)、音频编码器等分别提取各模态的高维特征。

- 模态桥接器(投影层):一个轻量级的线性层或小型MLP,将非文本特征(如图像特征)投影到文本特征空间(LLM的嵌入空间)。这是实现“对齐”的关键组件。

- 大语言模型核心:一个强大的预训练LLM(如LLaMA、PaLM架构)作为推理和生成引擎。投影后的多模态特征被当作特殊的“视觉token”与文本token一起输入LLM。

这种设计实现了能力的复用:LLM强大的语言理解和生成能力被直接用于多模态任务,只需训练投影层并对整个模型进行指令微调。

训练范式与挑战

训练一个高效的LMM通常分为多个阶段:

- 预训练与对齐:在海量网络爬取的图文对数据上训练,主要学习基础的跨模态关联。

- 指令微调:使用高质量的指令-响应对数据(如“描述这张图”、“基于图表回答问题”)来激发模型的遵循指令和复杂推理能力。

- 人类反馈强化学习:进一步对齐人类偏好,提升回答的有用性、安全性和准确性。

主要挑战

- 数据瓶颈:高质量、精确对齐的多模态数据稀缺,噪声数据会导致“幻觉”(如错误描述图片细节)。

- 计算成本:处理高分辨率图像和长视频序列需要巨大的计算和内存开销。

- 模态偏见:模型可能过度依赖某一强势模态(如文本)进行推理,而未能充分利用视觉信息。

应用场景与实例

LMMs正在开启一系列革命性的应用:

- 无障碍技术:为视障人士实时描述周围环境或图片内容。

- 教育:充当全能导师,解答数学题(识别手写公式)、解释科学图表、辅导外语(结合发音和文字)。

- 内容创作与营销:根据文字简报生成广告草图,或为视频自动生成字幕和亮点摘要。

- 科研与数据分析:阅读学术论文中的图表并总结发现,或从显微镜图像中提取定量信息。

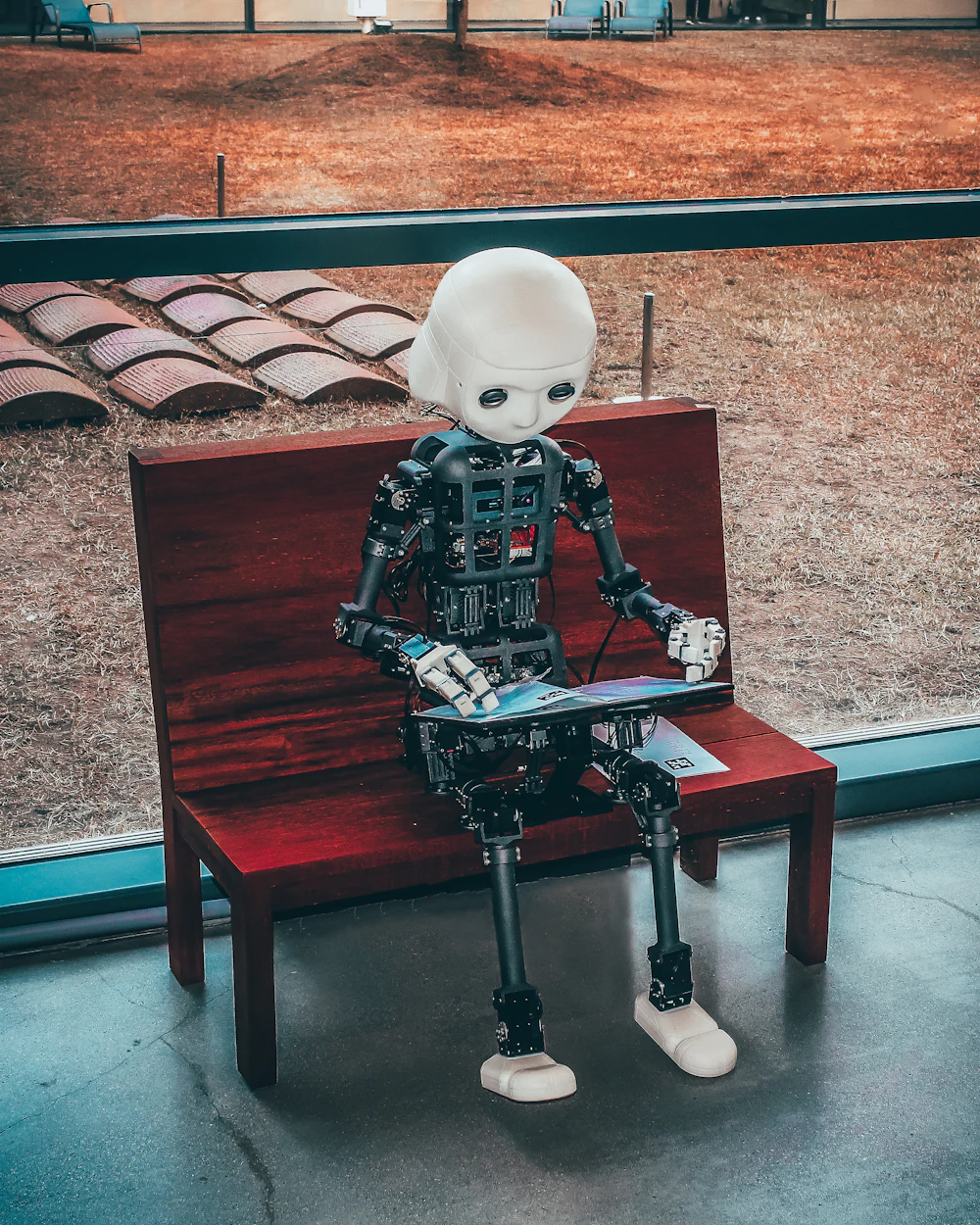

- 交互式代理:作为机器人或虚拟助手的大脑,通过摄像头观察物理世界并执行复杂指令。

图3: 多模态大模型广泛的应用前景。

代码演示:调用多模态API

以下示例展示了如何使用 OpenAI 的 GPT-4V(视觉)API 进行简单的图像内容问答。这体现了LMMs如何以编程方式被集成到应用中。

import openai

from PIL import Image

import requests

import base64

# 1. 准备图像(本地文件或URL)

image_path = "scientific_chart.png" # 假设有一张科学图表

# 或者使用网络图片: image_url = "https://example.com/chart.jpg"

# 2. 编码图像(对于本地文件)

def encode_image(image_path):

with open(image_path, "rb") as image_file:

return base64.b64encode(image_file.read()).decode('utf-8')

base64_image = encode_image(image_path)

# 3. 构建请求

client = openai.OpenAI(api_key="your-api-key-here")

response = client.chat.completions.create(

model="gpt-4-vision-preview", # 或最新的多模态模型名称

messages=[

{

"role": "user",

"content": [

{"type": "text", "text": "请总结这张图表的主要发现。数据趋势是什么?"},

{

"type": "image_url",

"image_url": {

"url": f"data:image/png;base64,{base64_image}"

# 如果使用网络图片,则用: "url": image_url

}

}

]

}

],

max_tokens=500

)

# 4. 输出结果

print("模型回复:")

print(response.choices[0].message.content)这段代码将图像和文本问题一起发送给多模态模型,模型能够“看到”图像并基于其内容生成文本回答,实现了跨模态的交互。

面临的挑战与风险

尽管前景广阔,LMMs的发展也伴随着严峻的挑战:

- 幻觉与事实性:模型可能生成看似合理但完全错误的图像描述,在医疗、法律等高风险领域尤其危险。

- 安全与滥用:强大的视觉理解能力可能被用于制造深度伪造、自动化网络攻击或侵犯隐私(如从图片中识别敏感信息)。

- 偏见放大:训练数据中的社会文化偏见会在多模态输出中被继承和放大。

- 评估困难:如何全面、可靠地评估一个模型在开放世界多模态任务上的能力,仍是一个未解决的难题。

- 能效与可及性:庞大的模型规模限制了其在边缘设备上的部署,加剧了AI的能源消耗和数字鸿沟。

未来展望

多模态大模型是通向更通用人工智能(AGI)道路上的重要里程碑。未来的研究方向可能包括:

- 更高效的架构:探索MoE(混合专家)、状态空间模型等新架构,以降低计算成本。

- 动态多模态:从静态图文向实时视频、3D点云、触觉信号等更丰富、动态的模态扩展。

- 具身智能:将LMMs与机器人控制系统结合,实现“眼脑手”协同,完成物理世界的复杂任务。

- 可解释性与可控性:开发技术使模型的决策过程更透明,并允许人类更精细地控制其输出。

对于开发者和研究者而言,理解LMMs的原理不仅是跟上技术浪潮的需要,更是思考如何负责任地塑造未来人机交互界面的起点。随着开源模型(如 LLaVA、CogVLM)的不断成熟,更多的创新将在社区中涌现。